Video-LLaMA:一种用于视频的指令调谐视听语言模型

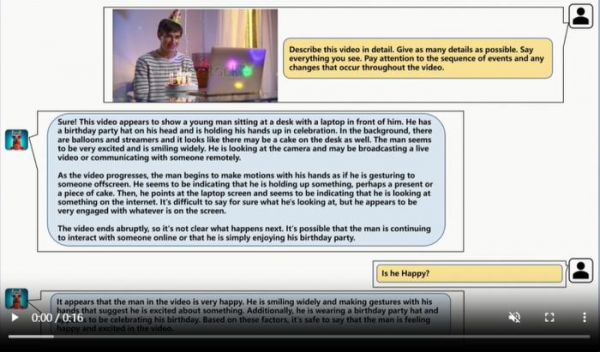

品玩6月6日讯,研究人员提出一种多模态框架:Video-LLaMA,,使语言模型能够理解视频中的视听内容。通过跨模态训练,解决了视频难以理解的挑战,包括捕捉时间变化和整合音视频信号。研究表明Video-LLaMA能够感知和理解视频内容,并生成基于视听信息的有意义回答。该研究为开发音视频AI助手提供了潜在的原型。已提供代码、预训练模型和演示。

论文链接:https://huggingface.co/papers/2306.00958

发布于:北京

相关推荐

Video-LLaMA:一种用于视频的指令调谐视听语言模型

首次:微软用GPT-4做大模型指令微调,新任务零样本性能再提升

语言与大模型:通向AGI之路

AI大语言模型,国内大厂能否弯道超车?

部署像ChatGPT这样的大语言模型,到底要花多少钱?

微软发布史上最大AI模型:170亿参数横扫各种语言建模基准,将用于Office套件

谷歌发布万亿参数语言模型, AI的语言功能真的可以超越人类吗?

大模型“涌现”的思维链,究竟是一种什么能力?

大语言模型能拯救互联网大厂吗?

百度正式推出大语言模型“文心一言”

网址: Video-LLaMA:一种用于视频的指令调谐视听语言模型 https://m.xishuta.cn/newsview77983.html