主动式智能体座舱,当今智能汽车的“自动挡”

智能座舱行业有一个集体回避的问题:大模型上车之后,真正改变了什么?

不是没有改变,但如果诚实地说,大多数改变仍然发生在交互层,你的问题可以更复杂,答案可以更自然,但车还是那辆车,座舱还是那个座舱,它仍然在等你发号施令。

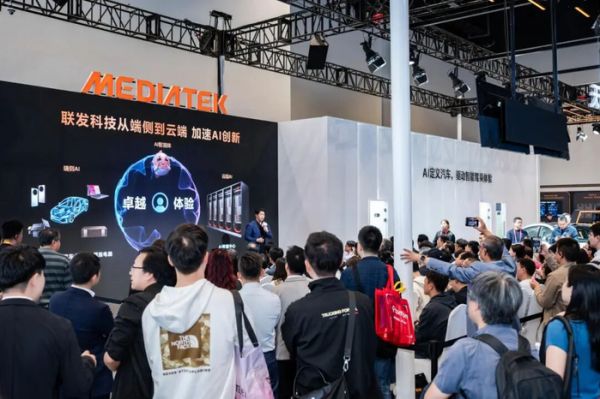

联发科在这届北京车展上,做了一件更难的事:让座舱从被动等待转变为“主动做事”。

这是一次底层架构的重构,感知、记忆、多任务并发,每一层都需要重做。他们把这套东西叫作“智能体座舱”,2026北京车展正式亮相。

“AI定义汽车”:

一个极具挑战但准确的判断

在AI定义汽车的大趋势下,各环节都需要拥抱AI。需要明确的一点是,在座舱领域,把AI当成座舱的新功能来用,和把AI当成座舱的底层架构来设计,是两件完全不同的事。

前者是大多数厂商在做的事,车机里加一个大模型,让语音助手更聪明一点,回答问题更自然一点。这当然有价值,但它本质上是在旧框架上叠加新能力,能力再强,体验的天花板也看得见。

后者,把AI当成座舱的底层架构来设计,才是联发科真正在推动的判断:AI不应该跑在座舱的上层软件里,而应该深入到芯片架构本身,成为整个座舱系统的底层驱动力。

毕竟,当感知、记忆、判断、执行四件事从零开始在芯片层面协同设计,它带来的改变就不是更好的助手,而是一种完全不同的工作方式。

AI定义汽车在座舱上的落地,指的就是这件事。

过去一年,这套判断正在被市场验证。行业讨论的焦点已经从能不能上大模型,变成上了大模型,座舱体验到底能提升多少,问题变了,说明方向已经被接受了。

很显然,未来的竞争,不是谁上了大模型,而是谁能把大模型真正嵌进架构里,让它从底层重构座舱的感知和响应逻辑。

这个判断并不新颖,但能在行业还在讨论电动化和智驾的时候提前说出来,需要的不只是技术视野,还有对汽车产业节奏的判断力。

它能否真正落地,取决于一件事:底层的硬件平台,是否为这套逻辑做好了准备。

联发科智能体座舱解决方案,就是为推动AI定义汽车而生。

主动式的智能体座舱:

三个维度,重新定义“聪明的车”

“主动式”这三个字,是理解这次联发科在北京车展所呈现内容的核心关键词。

先从一个具体场景说起。

阳光很烈,你准备下车。座舱主动提醒你:今天紫外线强,记得带伞。

没有语音唤醒,没有按钮,没有任何人触发任何指令。车机自己判断了天气、识别了你要下车的动作,在恰当的时机,说了一句恰当的话。

这个场景听起来不复杂,但要真正实现它,需要同时满足三件事:车机得能持续感知外部环境,得记得住你的习惯,还得在你有其他事情要处理的时候不打扰你,等你真正要走了,再开口。

拆解一下这个场景,至少需要三层能力的协同:全模态交互、主动式服务和全场景任务执行。

单独做到其中一件不难。三件同时发生,而且不互相干扰,这才是主动式智能体座舱真正的工程难点。

其中,全模态交互是一切的起点,通俗点说,就是“感知”。

传统座舱等你说话,主动式座舱要先读懂环境。这意味着车机要整合视觉、听觉、触觉等多维度输入,理解语义模糊的表达,同时持续监测舱内成员的状态和情绪、感知车外环境的变化,这些信号,大多数时候不是用户主动发出的,而是座舱需要自己去捕捉的。感知维度越宽,“主动”才越有底气。

但光会感知还不够,还要有记忆。即“知道你的过去,预判你的未来”。

一个没有记忆的助手,每次启动都从零开始,永远学不会你的习惯。主动式的智能体座舱需要长时在线、持续积累,才能建立起对“这个人通常在什么时候需要什么”的预判能力,这对系统的持续运行和存储调度,提出了完全不同于传统车机的要求。

最难的,是全场景任务执行。 汽车不是一个人的空间。驾驶员需要导航提示,后排孩子在看动画,副驾想换首歌,三个需求同时存在,三个智能体进程要同时跑,互不干扰,各自响应。这是真实家庭出行的常态,也是大多数现有座舱系统最容易崩掉的地方。

要在车里同时撑起全模态交互、主动式服务和全场景任务执行这三件事,芯片本身必须重新设计。联发科天玑汽车座舱平台C-X1给出的答案是:

3nm 制程、至高 400 TOPS 全模态 AI 算力,加上支持多进程服务(MPS)的并发架构,多个大模型任务进程可以同时共享 GPU 运算单元,吞吐量最高提升 50%。与此同时,通过软硬协同优化,大模型带宽需求被压缩至原来的10%。

算力更强,功耗不暴涨。这句话在手机上说说就算了,在车里,它是一个必须解决的工程约束。

从芯片到生态:

天玑汽车平台的真正护城河

对于汽车厂商来说,买一颗芯片,只是起点。真正的问题是:这颗芯片能不能让我快速落地想要的 AI 能力,能不能降低我的开发成本,能不能持续兼容最新的模型?

这是 联发科在北京车展着重呈现的第二条叙事线:从芯片向上,延伸至模型层、应用层、生态层的全栈能力。

模型层:联发科打通 CUDA 生态,让开发者没有迁移门槛。

坦白说,天玑汽车座舱平台C-X1 选择打通 CUDA 生态,是一个很清醒的决策。CUDA 是目前全球大模型开发、训练的核心生态,端云同架构意味着开发者已有的模型能力可以直接迁移到车端,不需要重写,不需要再适配一遍。在 AI 模型迭代速度如此之快的今天,谁能用最低成本跟上最新的模型进展,谁就掌握了持续的主动权。

应用层:MDAP天玑座舱软件方案,降低车企开发门槛。

这套方案预先整合了视觉、语音、情绪等多维度感知数据的 API,把智能体所需的底层信息接口都封装好了。

对车企来说,原本要自己搭的感知数据管道不用从零开始,可以直接在这个基础上做差异化的体验。再加上端侧编排器(Orchestrator)的引入,端云任务怎么分工、哪些推理跑本地、哪些走云端,都可以动态配置,响应速度保住了,云端成本也降下来了。

这是一套帮车企提效的工具链,可以帮助体验快速迭代。

生态层:3A 游戏上车,超越以往的想象空间

如果说以上是“平台能力”,那么这次北京车展上的另一条线,则是“生态落地”的展示。

天玑汽车座舱平台 C-X1 集成了 NVIDIA RTX GPU 光线追踪技术及 DLSS 技术,为车载场景带来至高 4K@60FPS 的图形渲染能力。这是 3A 级游戏首次真正意义上进入汽车座舱的技术门槛,画面质量可以媲美主机级游戏。

当然,这件事的意义不只是娱乐体验的提升,更代表了一个信号:当车里的屏幕和算力可以跑3A游戏,整个车载内容生态的想象空间就被重新打开了。

此外在联接技术方面,联发科同步展示了 5G 先进技术、卫星通信、Wi-Fi 8 与双蓝牙的新一代方案。主动式智能体座舱的“主动”,建立在持续在线的前提上,本地算力再强,断网就失去了一半能力,云端与端侧 AI同步演进,才是完整的体验。

汽车座舱的竞争,

刚刚进入真正有趣的阶段

从电动化到智能化,中国汽车行业完成了一次教科书级别的弯道超车。但智能化的下半场,竞争维度正在悄然升维。

电池续航可以卷,辅助驾驶可以卷,屏幕尺寸可以卷。但主动式智能体座舱所需要的,是算力、模型、生态、软件方案的系统性积累——这是一场门槛更高、周期更长、壁垒更深的竞争。

智能化下半场,车企们不需要单点技术突破,而是需要一套从芯片到生态、从被动响应到主动感知的完整技术架构,联发科用天玑汽车平台所展示的就是这种解法。

这个时代最贵的资产,不只是单纯的产品或技术,是提前布局长期方向后积累的生态密度。2024年,联发科就已抢跑,今年的北京车展可以很明显的看到,其已经跑在生态位的最前列。

发布于:广东

相关推荐

主动式智能体座舱,当今智能汽车的“自动挡”

迈进全域AI时代!吉利宣布:Eva智能体、新AI座舱来了

千问大模型“上车”,宝马携手阿里打造座舱智能体

北汽元境智能正式发布 车辆升级“全域智能体”

智驾平权时代,智能座舱如何成为车企的 “新战场”?

智能汽车“增量部件”争夺战:陷入屏幕误区的智能座舱

AI创新进入“中国时间”,智能座舱领域“OpenAI”崛起

从IDC测评看AI上车:斑马智行全面领跑,破局座舱“伪智能”

从智能座舱到数字化转型 | 上海车展

自动驾驶与智能座舱体验观察

网址: 主动式智能体座舱,当今智能汽车的“自动挡” https://m.xishuta.cn/newsview149079.html